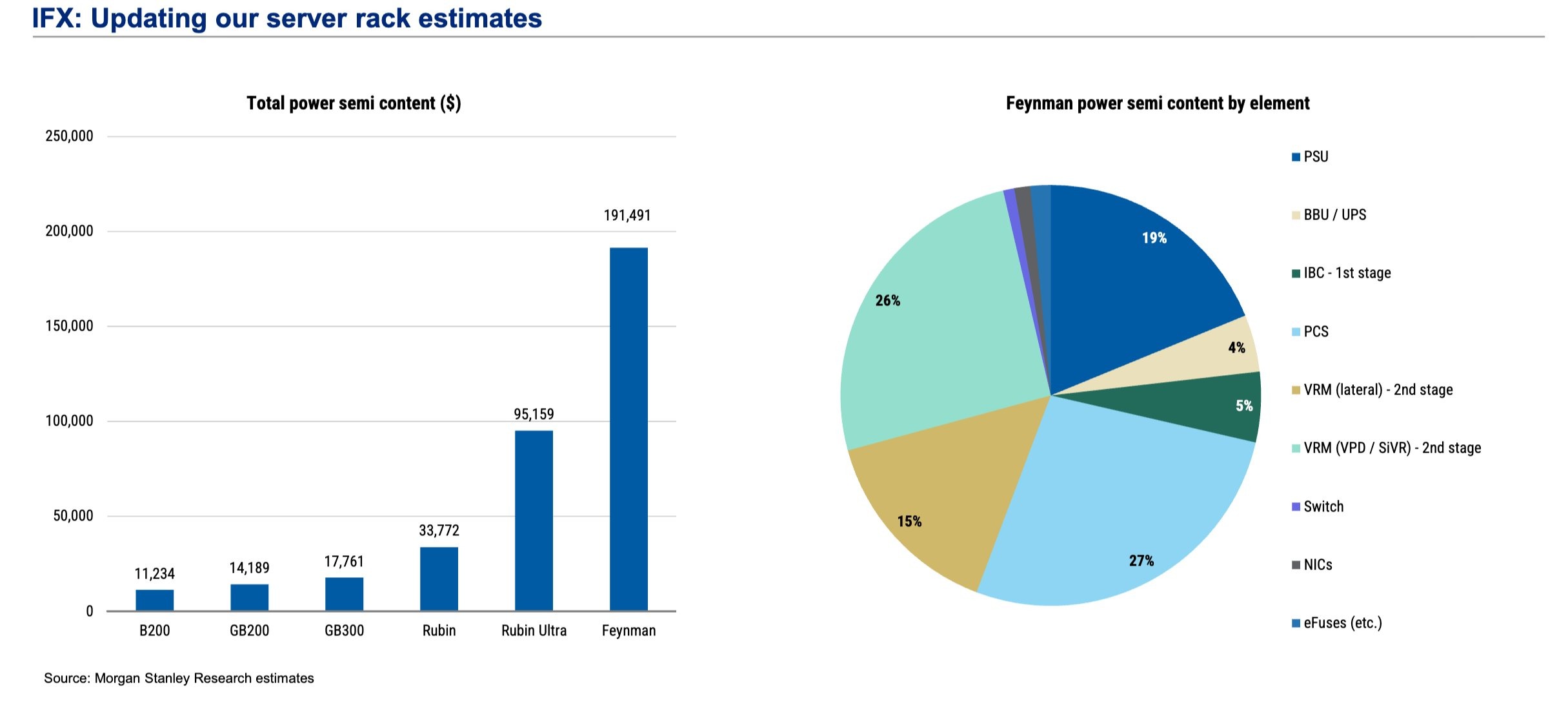

NVIDIA Feynman đang gây chú ý không phải vì giá bán GPU, mà vì chi phí linh kiện bán dẫn cho khối nguồn đi kèm mỗi rack AI tăng vọt. Theo dữ liệu Morgan Stanley Research được WCCFtech dẫn lại, power semiconductor content của một rack Feynman có thể lên khoảng 191.491 USD, cao gấp 17 lần mốc 11.234 USD của B200. Đây là tiền cho phần chuyển đổi, điều áp và phân phối điện trong cả rack, không phải giá của bản thân GPU. Với giới theo dõi hạ tầng AI, chi tiết này cho thấy nút thắt lớn tiếp theo không nằm ở số nhân tính toán, mà ở việc cấp điện cho các cụm máy chủ ngày càng ngốn công suất.

Vì sao NVIDIA Feynman khiến chi phí linh kiện nguồn tăng mạnh?

Theo phân tích của WCCFtech, Blackwell B200 khởi đầu ở mức 11.234 USD giá trị linh kiện nguồn cho mỗi rack, GB200 tăng thêm gần 4.000 USD và GB300 lên 17.761 USD. Từ đó trở đi, đường tăng giá dựng đứng hơn hẳn: Rubin vượt 33.000 USD, Rubin Ultra lên khoảng 95.000 USD và NVIDIA Feynman chạm hơn 191.000 USD. Điều đáng chú ý là chi phí leo thang này không đến từ một bộ phận riêng lẻ, mà từ cả hệ nguồn phải nâng cấp để nuôi rack AI mật độ cao hơn.

Điều đó giúp giải thích vì sao các nền tảng như Nvidia GB300 thường được xem là bước đệm cho một chu kỳ hạ tầng mới. Khi số GPU trên mỗi rack tiếp tục tăng, phần nguồn điện không còn là lớp hỗ trợ phía sau, mà trở thành một hạng mục đầu tư có thể quyết định tổng chi phí triển khai, diện tích rack và cả tốc độ mở rộng datacenter.

Trong cơ cấu chi phí của NVIDIA Feynman, PCS chiếm khoảng 27%, tầng VRM thứ hai chiếm 26% và PSU chiếm 19%. Phần còn lại nằm ở lateral VRM, IBC, pin dự phòng, UPS, NIC, switch và eFuse. Nói cách khác, chỉ cần công suất rack nhích thêm một bậc thì cả chuỗi chuyển đổi điện lẫn ổn định điện áp đều phải tăng cấp đồng thời.

800V DC có ý nghĩa gì với cuộc đua hạ tầng AI?

Chuẩn 48V hoặc 54V cũ bắt đầu lộ giới hạn khi ngành muốn đẩy rack AI lên hàng trăm kilowatt, thậm chí tiến gần ngưỡng megawatt. NVIDIA cho biết nếu vẫn giữ cách phân phối điện cũ, riêng power shelf có thể chiếm tới 64U ở rack quy mô megawatt, gần như ăn hết không gian cho phần tính toán. Điện áp thấp cũng kéo theo dòng điện lớn, lượng đồng nhiều và số lần chuyển đổi AC/DC dày hơn. Với NVIDIA Feynman và thế hệ rack sau Rubin, 800V DC được xem là cách giảm dòng, bớt cáp đồng, giảm hao hụt và nhường chỗ cho GPU lẫn làm mát chất lỏng.

| Thế hệ rack AI | Giá trị linh kiện nguồn ước tính | Ý nghĩa thực tế |

|---|---|---|

| B200 | 11.234 USD | Mốc nền của Blackwell, chi phí nguồn vẫn còn dễ kiểm soát |

| GB300 | 17.761 USD | Tăng thêm do rack dày đặc hơn, nhưng chưa bùng nổ |

| Rubin | Hơn 33.000 USD | Bắt đầu cần kiến trúc điện mới |

| Rubin Ultra | Khoảng 95.000 USD | Phần nguồn điện trở thành khoản đầu tư lớn |

| Feynman | Khoảng 191.491 USD | Chi phí nguồn tự nó đã là bài toán chiến lược |

Tác động rộng hơn là các hãng xây datacenter giờ không chỉ hỏi mua GPU nào, mà còn phải tính kiến trúc điện nào theo kịp cụm máy quy mô cực lớn. Điều này khá ăn khớp với những tín hiệu gần đây quanh NVIDIA Rubin, khi quy mô triển khai đã được nói tới ở mức hàng chục nghìn đến hàng trăm nghìn GPU. Ở mức đó, lợi thế cạnh tranh không chỉ đến từ chip nhanh hơn, mà từ việc mỗi megawatt điện được đổi thành năng lực tính toán hiệu quả tới đâu.

NVIDIA Feynman vì thế là lời nhắc rằng cuộc đua AI đang dịch từ chip sang cả tầng nguồn điện phía sau rack. Nếu dự báo này đúng, các nhà làm PSU, VRM, GaN và SiC sẽ hưởng lợi không kém những hãng bán GPU. Với thị trường hạ tầng AI, đây là lúc bài toán điện năng bắt đầu quan trọng ngang với bài toán hiệu năng.