Để tránh cho trí tuệ nhân tạo của mình bị “ảo giác” – tức là hiện tượng cung cấp thông tin sai lệch hoặc không có thật, Apple đã thiết lập những quy tắc ngăn cản trí tuệ nhân tạo đưa ra thông tin không chính xác.

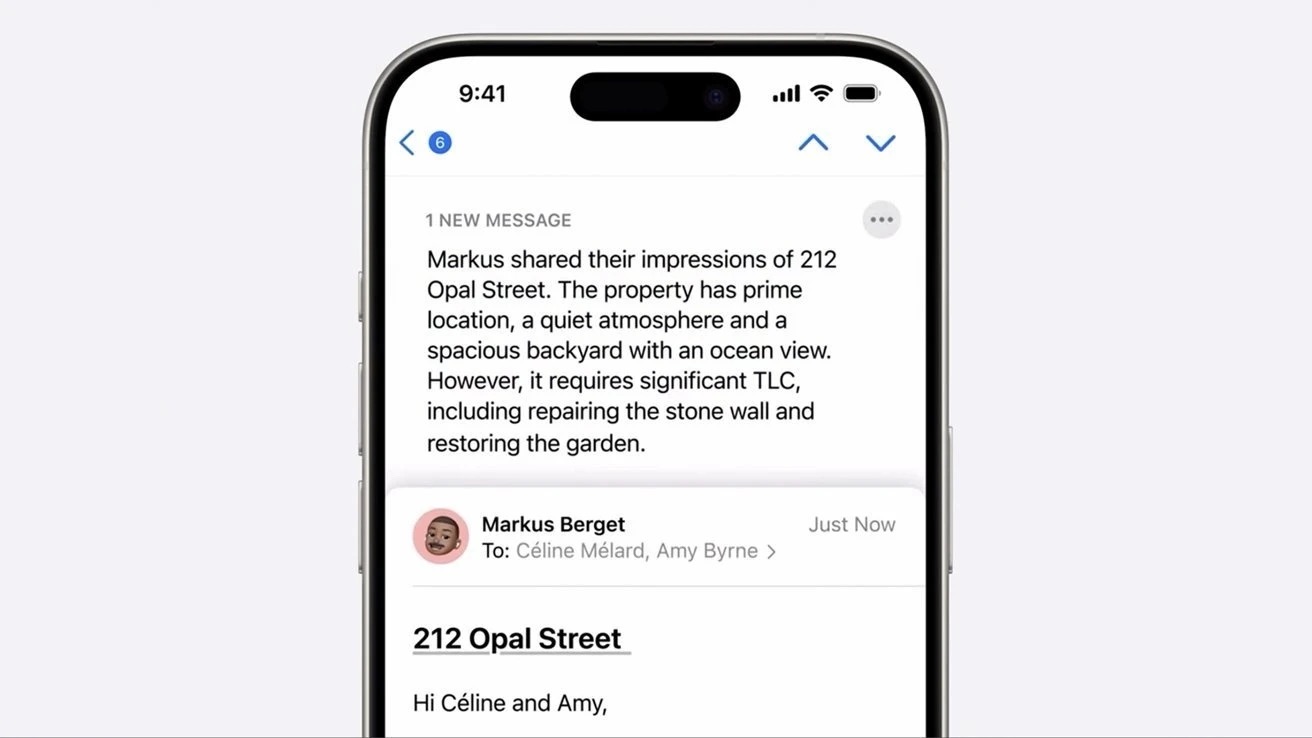

Được giới thiệu tại sự kiện WWDC 2024, Apple Intelligence là bộ tính năng trí tuệ nhân tạo (AI) được tích hợp trên iPhone, iPad và máy tính Mac, cho phép người dùng tạo ra nội dung, hình ảnh và tóm tắt văn bản.Thông qua Apple Intelligence, người dùng có khả năng tạo ra hình ảnh bằng công cụ Image Playground và nhận được tóm tắt từ email, thông báo cũng như nhiều loại văn bản khác nhau.

Hơn nữa, công nghệ AI của Apple còn sở hữu tính năng Smart Replies, giúp việc trả lời email và tin nhắn trở nên dễ dàng hơn rất nhiều. Tuy nhiên, giống như nhiều hệ thống AI khác, đã có không ít người đặt ra câu hỏi về hiện tượng ảo giác liên quan đến Apple Intelligence.

Cấm cung cấp thông tin sai lệch

Theo IBM, hiện tượng ảo giác (hallucination) liên quan đến các mô hình ngôn ngữ lớn (LLM), như chatbot hoặc công cụ nhận diện hình ảnh, xảy ra khi chúng phát hiện mẫu dữ liệu không có thực hoặc không thể được con người nhận diện, dẫn đến việc tạo ra kết quả không chính xác hoặc sai lệch.

Nói rõ hơn, người dùng thường mong muốn AI cung cấp kết quả chính xác dựa trên thông tin mà nó đã được đào tạo. Tuy nhiên, trong một số tình huống, đầu ra của AI lại không được xây dựng từ dữ liệu chính xác, gây ra hiện tượng phản hồi “ảo giác”.

Trong báo cáo độc quyền của AppleInsider về dự án BlackPearl, để khắc phục vấn đề này, Apple đã xác định và tích hợp một số câu lệnh (prompt) vào hệ điều hành, nhằm tạo thành rào cản cho trí tuệ nhân tạo trong quá trình hoạt động.

Trong một ví dụ, yêu cầu của Apple bắt đầu bằng việc chỉ định cho AI đóng vai trò như một chuyên gia trong việc tạo ra tóm tắt cho một loại văn bản nhất định. AI nhận nhiệm vụ duy trì vai trò này và hạn chế phản hồi của mình theo độ dài đã được đặt trước, có thể là 10 từ, 20 từ hoặc ba câu, tùy thuộc vào mức độ tóm tắt cần thiết. Khi thực hiện tóm tắt tin nhắn, thông báo và ngăn xếp thông báo, phần mềm AI của Apple được yêu cầu chú ý đến những chi tiết quan trọng liên quan đến người dùng cuối, bao gồm tên, địa điểm và thời gian. AI cũng được hướng dẫn tìm hiểu về chủ đề chung của tất cả các thông báo.

AppleInsider đã chỉ ra rằng đoạn yêu cầu này mang lại cái nhìn sâu sắc về các vấn đề mà Apple dự đoán và làm rõ những gì phần mềm AI cần tránh khi tạo ra phản hồi dưới dạng văn bản hoặc hình ảnh. Khái niệm ảo giác thường gắn liền với não bộ của con người hoặc động vật, chứ không phải với máy móc. Tuy nhiên, khái niệm này cũng được áp dụng cho AI để mô tả chính xác cách thức mà mô hình tạo ra kết quả. Nó tương tự như cách mà con người đôi khi thấy những vật thể lạ trên bầu trời, nghe âm thanh không rõ nguồn gốc hoặc cảm nhận thứ gì đó chạm vào cơ thể họ.

Theo như một người dùng trên Reddit phát hiện, để ngăn chặn hiện tượng này, Apple đã đưa vào công cụ soạn thảo một yêu cầu với chỉ dẫn nhằm đảm bảo an toàn. Cụ thể, Apple đã đưa ra tình huống: “Bạn là trợ lý giúp người dùng trả lời thư của họ. Khi nhận được thư, trước tiên bạn sẽ cung cấp một bản nháp phản hồi dựa trên một đoạn trích trả lời ngắn. Để làm cho bản nháp phản hồi trở nên đẹp mắt và đầy đủ hơn, bạn sẽ cung cấp một bộ câu hỏi và câu trả lời”.

Với yêu cầu này, Trí tuệ nhân tạo của Apple được giao nhiệm vụ viết một phản hồi ngắn gọn và tự nhiên bằng cách chỉnh sửa bản nháp phản hồi để kết hợp các câu hỏi đã cho cùng với câu trả lời tương ứng.

Trong đoạn kết, AI cần phải giới hạn câu trả lời trong 50 từ. Đặc biệt, trí tuệ nhân tạo không được phép “tưởng tượng” hoặc sáng tạo thông tin sai sự thật.

Ngăn chặn nội dung không phù hợp

Ngoài việc đối phó với vấn đề ảo giác, Apple còn hạn chế khả năng của AI trong việc tạo ra nội dung không phù hợp. Các giới hạn này đã được công ty áp dụng cho tính năng Memories trong ứng dụng Photos.

“Cấm tạo ra nội dung liên quan đến tôn giáo, chính trị, gây hại, bạo lực, tình dục, tục tĩu hoặc bất kỳ loại nội dung nào có tính tiêu cực, buồn bã hoặc khiêu khích”, đây là nội dung từ đoạn hướng dẫn của Apple trong tính năng Memories.

Theo thông tin từ AppleInsider, một số nguồn tin nội bộ tiết lộ rằng Apple luôn nỗ lực ngăn chặn phần mềm AI của mình tạo ra những loại nội dung này.

Trong các công cụ kiểm tra nội bộ liên quan đến Apple Intelligence, phần mềm của hãng sẽ từ chối cung cấp phản hồi nếu phát hiện có ngôn ngữ xúc phạm trong đoạn văn mà người dùng cung cấp.

Trong cuộc phỏng vấn với The Washington Post, Cook đã thừa nhận rằng ông “chưa bao giờ khẳng định” Apple Intelligence hoàn toàn không tạo ra thông tin sai lệch hoặc gây hiểu lầm.

“Tôi tin rằng chúng tôi đã hoàn tất mọi công việc cần thiết, bao gồm việc xem xét kỹ lưỡng khả năng áp dụng công nghệ vào các lĩnh vực khác nhau. Do đó, tôi hoàn toàn tự tin rằng (Apple Intelligence) sẽ đạt chất lượng cao. Tuy nhiên, tôi phải thẳng thắn rằng độ chính xác có thể không đạt 100%. Tôi chưa bao giờ khẳng định điều này,” Cook nhấn mạnh.

Dù vậy, với những đoạn prompt mang tính bảo vệ, có thể nhận thấy Apple đã rất chú trọng đến việc đảm bảo an toàn cho người sử dụng.

Apple Intelligence được phát triển nhằm cung cấp các chức năng AI với những lợi ích rõ ràng giúp việc giao tiếp trở nên dễ dàng hơn, dù là thông qua hình ảnh được tạo ra bởi AI hay văn bản tóm tắt do AI xử lý.

Tuy nhiên, AppleInsider cũng chỉ ra rằng mặc dù các đoạn prompt của Apple giúp giảm thiểu tỷ lệ xảy ra ảo giác và ngăn chặn việc sản xuất nội dung không phù hợp, nhưng vẫn chưa đủ để hoàn toàn ngăn chặn những vấn đề này.

Do vậy, người dùng vẫn có khả năng tìm ra cách “lách” hệ thống để thao túng các đoạn prompt, vì vậy không thể đảm bảo rằng AI của Apple sẽ không gây ra hiện tượng ảo giác hoặc tạo ra nội dung không thích hợp.

Theo Znews