Huawei được cho là đang dùng Flex:AI để kéo tỷ lệ sử dụng phần cứng AI trong cụm tính toán từ khoảng 35% lên mục tiêu 70%, thay vì chỉ lao vào mua thêm accelerator mới. Với Huawei, bài toán Huawei, AI chip lần này không nằm ở số lượng GPU mua thêm mà ở cách tận dụng cụm đang có. Điểm đáng chú ý ở đây không nằm ở một con chip mới, mà ở cách điều phối GPU và AI chip sao cho ít tài nguyên bị nằm chờ hơn. Với doanh nghiệp đang vận hành hạ tầng AI, chênh lệch đó ảnh hưởng trực tiếp tới chi phí điện, số job xử lý được và tốc độ mở rộng dịch vụ. Nói gọn hơn, đây là câu chuyện về hiệu suất cụm compute, không phải cuộc đua marketing đơn thuần.

Điều gì vừa xảy ra và dữ liệu nào xác thực?

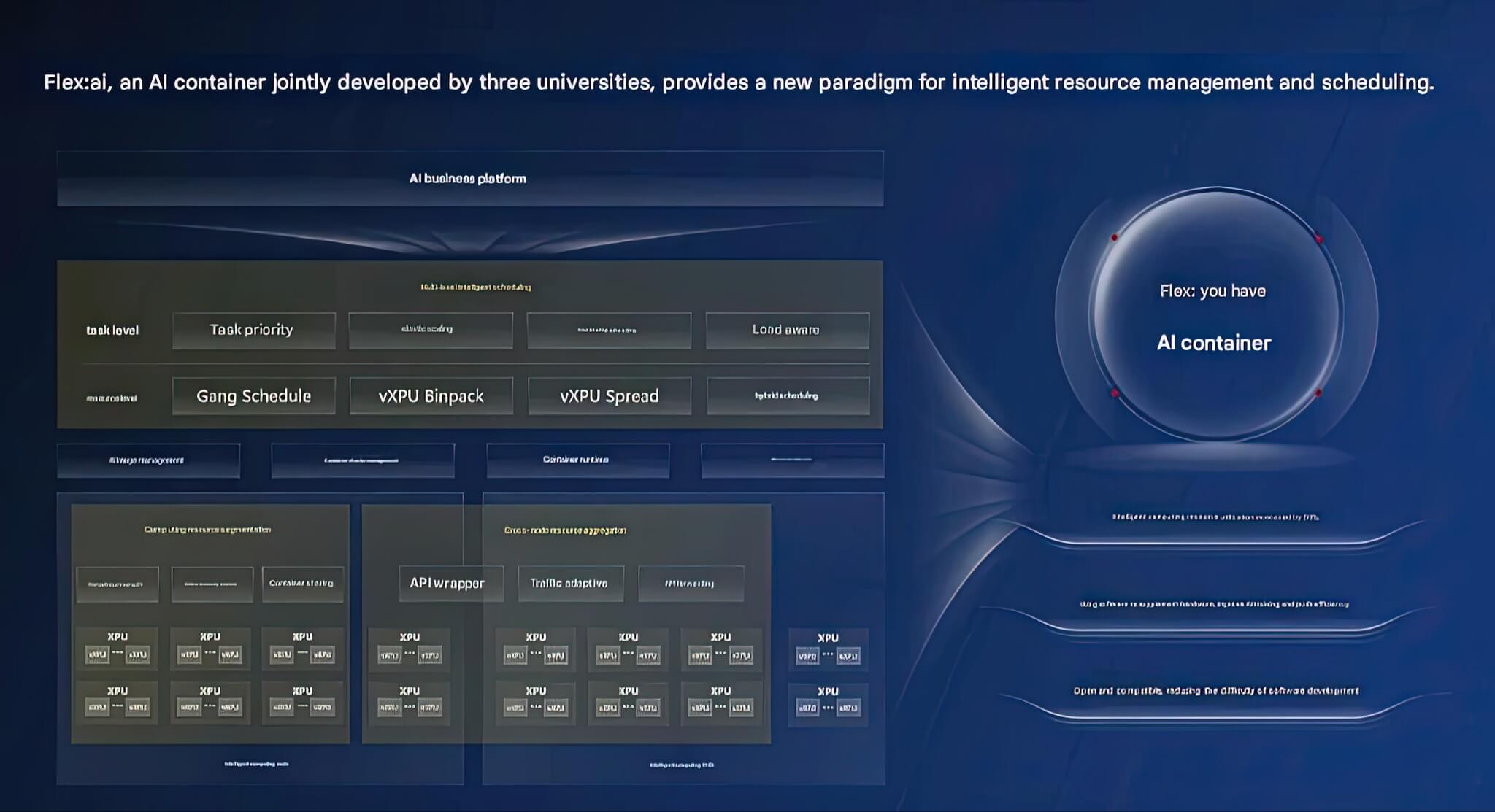

Thông tin từ nguồn gốc cho thấy Huawei đang giới thiệu Flex:AI như một lớp điều phối workload cho hạ tầng tăng tốc, với mục tiêu gom tài nguyên rảnh và chia 1 GPU cho nhiều tác vụ nhỏ hơn. Hai con số quan trọng nhất là mức sử dụng trung bình khoảng 35% và mục tiêu đẩy lên 70% khi hệ thống điều phối hoạt động hiệu quả hơn. Nếu diễn giải sang bài toán thật, cùng một cụm máy có thể nhận thêm nhiều phiên inference, OCR, embedding hoặc chatbot nội bộ trước khi doanh nghiệp phải nghĩ tới việc đặt thêm server Huawei, AI chip mới. Chi tiết về hướng đi này đang bám sát thông tin gốc từ Notebookcheck, và đây là kiểu tối ưu mà đội MLOps lẫn hạ tầng đều phải để mắt.

Nhưng cũng phải nói thẳng là 70% utilization chưa đủ để kết luận hệ thống tốt hơn toàn diện. Người mua compute vẫn cần benchmark độc lập về throughput, độ trễ p95, mức suy hao khi nhiều tenant chia cùng GPU và chi phí vận hành trên từng workload. Nếu cổ chai nằm ở mạng, lưu trữ hoặc framework, biểu đồ utilization đẹp hơn chưa chắc biến thành dịch vụ AI nhanh hơn. Trade-off ở đây là Flex:AI nghe hợp lý về mặt hạ tầng, nhưng thứ quyết định niềm tin cuối cùng vẫn là số đo độc lập chứ không phải lời hứa scheduler. Vì thế, các con số đẹp lúc ra mắt mới chỉ là điều kiện để theo dõi tiếp chứ chưa đủ để chốt ưu thế kỹ thuật.

Tác động thực tế với người dùng hoặc doanh nghiệp là gì?

Với doanh nghiệp Việt đang thuê GPU cloud hoặc dựng máy chủ AI nội bộ, câu chuyện này quan trọng vì phần cứng tăng tốc chưa bao giờ chỉ là tiền mua card. Còn cả điện, rack, mạng, lưu trữ, thời gian chờ của kỹ sư và số giờ GPU thực sự tạo ra giá trị. Khi utilization chỉ quanh 35%, một phần ngân sách đang bị đốt mà chưa chuyển thành job hoàn thành hay phản hồi cho người dùng cuối. Theo góc nhìn đó, lớp điều phối có thể đáng giá ngang với một đợt nâng cấp phần cứng, nhất là khi nguồn cung accelerator còn phức tạp như bài NVIDIA Blackwell đang định nghĩa lại cách doanh nghiệp nhìn vào Huawei, AI chip và GPU AI thế hệ mới.

Điều nên làm lúc này là nhìn Flex:AI như một tín hiệu rằng cuộc đua AI compute đang dịch từ mua thêm GPU sang tận dụng cụm hiện có tốt hơn. Cách đánh giá hợp lý là đo theo chi phí trên một triệu token, thời gian chờ trong queue, tỷ lệ job lỗi và điện năng cho mỗi phiên xử lý, thay vì chỉ nhìn con số utilization. Ai muốn theo dõi bức tranh phần mềm phía sau phần cứng có thể xem thêm AMD hỗ trợ Gemma 4 trên Radeon, Instinct và Ryzen AI để thấy compute hiện nay phụ thuộc ngày càng nhiều vào phần mềm điều phối. Nói ngắn gọn, Huawei đang chạm đúng một nỗi đau thật của thị trường AI, nhưng phải chờ benchmark độc lập mới biết đây là bước ngoặt hay chỉ là một thông điệp đẹp trong cuộc đua hạ tầng.