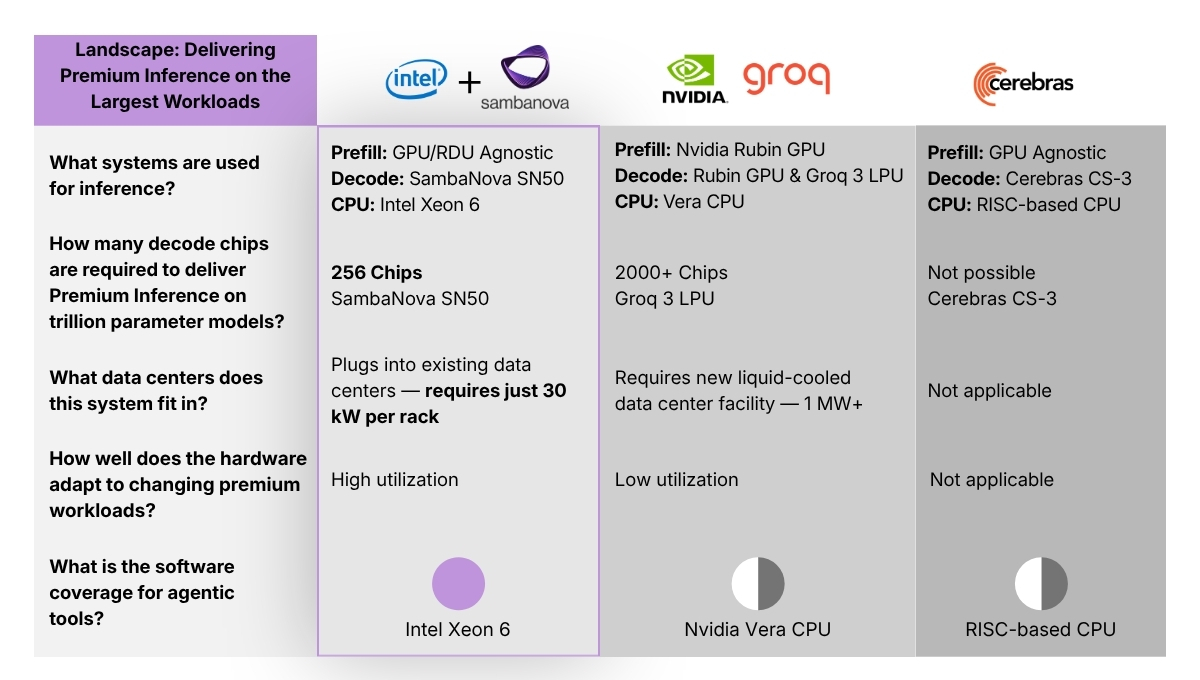

Intel và SambaNova đang thử một hướng đi khác cho hạ tầng AI: không dồn toàn bộ suy luận vào một cụm GPU duy nhất mà chia việc cho từng loại phần cứng phù hợp hơn. Mô hình Intel SambaNova này đáng chú ý vì nó biến AI inference từ bài toán mua phần cứng sang bài toán phối phần cứng. Theo Tom’s Hardware, GPU sẽ lo phần prefill với prompt dài, SambaNova SN50 RDU xử lý decode, còn Xeon 6 làm CPU chủ. Mục tiêu của mô hình này là giảm áp lực chi phí và điện năng khi doanh nghiệp đưa agentic AI vào vận hành. Hai công ty nói nền tảng sẽ nhắm tới doanh nghiệp và các dự án sovereign AI trong nửa cuối 2026. Cách phối phần cứng như vậy cho thấy cuộc đua AI hạ tầng đang bắt đầu chuyển từ mua nhiều GPU sang tối ưu từng workload.

Vì sao Intel và SambaNova không dồn hết việc sang GPU?

Cốt lõi của nền tảng mới là tách suy luận thành ba phần. Prefill, tức khâu đọc prompt dài và tạo key-value cache, vẫn là việc hợp với GPU hoặc bộ tăng tốc AI vì cần băng thông bộ nhớ lớn. Decode, tức giai đoạn sinh token liên tục để trả lời người dùng, được SambaNova đẩy sang SN50 RDU vì hãng cho rằng đây là phần cần tối ưu thông lượng riêng. Xeon 6 sau đó đảm nhiệm vai trò host CPU, điều phối workload và chạy các tác vụ kiểu agent như thực thi mã, gọi công cụ hoặc xác thực đầu ra.

Điều này quan trọng vì doanh nghiệp không mua phần cứng AI chỉ để lấy benchmark đẹp. Họ còn phải tính chi phí điện, làm mát, độ trễ, phần mềm nội bộ và khả năng gắn hệ thống mới vào data center sẵn có. Trong thông báo chính thức, Intel cho biết hệ sinh thái trung tâm dữ liệu hiện vẫn bám rất chặt vào x86, nên để Xeon 6 đứng ở vai trò host và action CPU sẽ dễ giữ tương thích hơn. Đây cũng là lý do câu chuyện này nên được đặt cạnh bài toán chi phí bộ nhớ AI, vì áp lực đầu tư cho AI lúc này không còn nằm ở mỗi GPU.

Một điểm đáng chú ý khác là Intel và SambaNova nói hệ thống SN50 cùng server dùng Xeon có thể triển khai trong data center chịu tải khoảng 30kW, mức vẫn phổ biến ở nhiều doanh nghiệp. Nếu điều này đúng trong thực tế, lợi thế lớn nhất của mô hình dị thể không phải là thông số phô trương mà là giảm rào cản nâng cấp hạ tầng. Intel SambaNova AI inference vì thế đang trở thành bài toán tối ưu tổng thể thay vì chỉ là cuộc đua số GPU.

Nền tảng AI inference dị thể này tác động gì tới thị trường AI hạ tầng?

Với Intel, đây là cách chen vào cuộc đua AI mà không cần thắng bằng GPU thuần túy. Tom’s Hardware nhận định cách tách prefill, decode và token generation có nét giống định hướng Rubin của Nvidia, nhưng khác ở chỗ Intel muốn giữ Xeon 6 ở vị trí trung tâm trong hệ thống. Điều đó giúp hãng bảo vệ vai trò của CPU trong data center, đồng thời biến Xeon thành phần tạo giá trị trực tiếp cho suy luận AI thay vì chỉ làm nền.

Với SambaNova, hợp tác cùng Intel là cơ hội đưa RDU thành lựa chọn nghiêm túc cho lớp decode, nơi tốc độ sinh token ảnh hưởng trực tiếp tới trải nghiệm chatbot, trợ lý doanh nghiệp và coding agent. Intel cũng dẫn dữ liệu nội bộ rằng Xeon 6 có thể biên dịch LLVM nhanh hơn hơn 50% so với CPU server Arm và đạt hiệu năng cơ sở dữ liệu vector cao hơn tới 70% so với đối thủ x86 mà hãng ám chỉ là AMD EPYC. Những số liệu này vẫn cần kiểm chứng độc lập, nhưng nếu đúng ở workload thật, lợi ích sẽ thể hiện ở việc agent phản hồi nhanh hơn và hoàn thành tác vụ ổn định hơn.

Với bên mua hạ tầng, câu hỏi quan trọng nhất là tổng chi phí sở hữu có giảm hay không. Một kiến trúc dị thể hợp lý có thể tránh lãng phí GPU cho các tác vụ mà CPU hoặc RDU làm hiệu quả hơn, đồng thời cho phép doanh nghiệp tận dụng nhiều phần của hệ thống hiện có. Nếu thị trường chấp nhận hướng đi này, cuộc đua AI trong 12 đến 18 tháng tới có thể bớt xoay quanh chuyện “mua được bao nhiêu GPU” và chuyển sang chuyện phối phần cứng ra sao để chạy suy luận hiệu quả hơn. Theo nghĩa đó, Intel SambaNova AI inference là một phép thử thực dụng hơn cho cách xây hạ tầng AI doanh nghiệp.