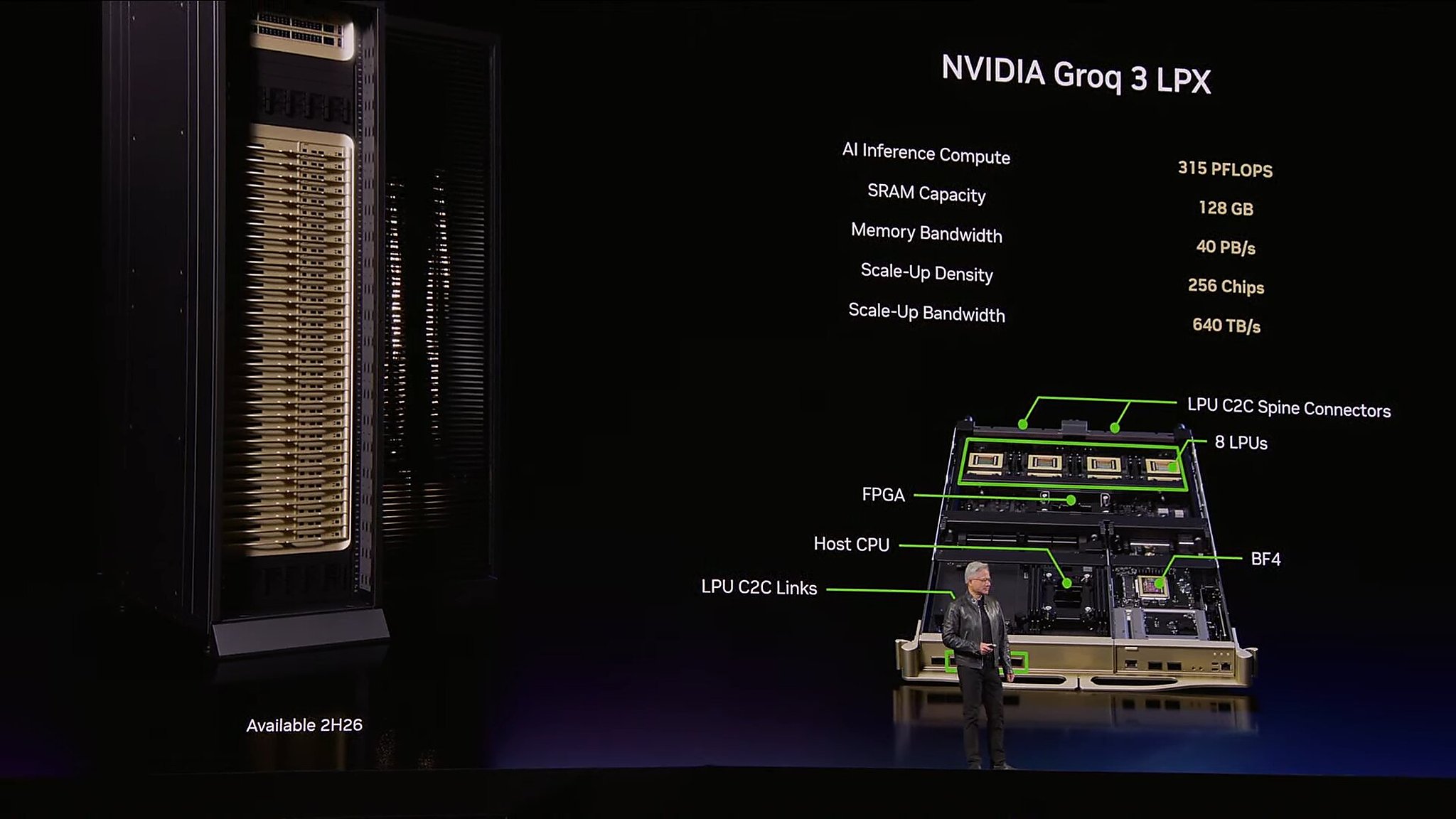

Tại GTC 2026, NVIDIA trình làng dàn chip Rubin hoành tráng nhưng lại thiếu đúng một cái tên: Rubin CPX. Đây là chip inference dùng bộ nhớ GDDR7, từng được kỳ vọng sẽ cạnh tranh trực tiếp với các ASIC chuyên dụng. VP Ian Buck sau đó xác nhận CPX đang bị hoãn vô thời hạn và có thể quay lại muộn nhất năm 2028 cùng thế hệ Feynman. Thay thế cho vị trí đó là Rubin LPX tray tích hợp Groq LPU với băng thông lên tới 640 TB/s cho toàn rack.

Tại sao NVIDIA khai tử Rubin CPX

Rubin CPX được thiết kế để xử lý workload prefill trong inference, tức là giai đoạn nạp context đầu vào trước khi mô hình sinh ra token. Khi GDDR7 được chọn làm bộ nhớ cho CPX, ý tưởng này hoàn toàn hợp lý vì prefill cần băng thông bộ nhớ lớn để đọc hàng tỷ tham số. Tuy nhiên, thị trường AI đã thay đổi nhanh hơn dự tính của NVIDIA.

Nhu cầu của khách hàng hiện nay không còn tập trung vào xử lý ngữ cảnh dài mà chuyển sang tối ưu TTFT (Time To First Token), tức là rút ngắn thời gian chờ trước khi nhận được token đầu tiên từ mô hình. Điều này có nghĩa là giai đoạn decode mới là điểm nghẽn cần giải quyết, không phải prefill. Kiến trúc GDDR7 của CPX không phải lựa chọn tối ưu cho bài toán decode, nên NVIDIA đã quyết định hoãn toàn bộ chip này.

VP Ian Buck tiết lộ hãng đang cân nhắc thay GDDR7 bằng HBM cho phiên bản CPX tương lai, nghĩa là phiên bản Feynman sẽ khác hoàn toàn so với thiết kế Rubin CPX ban đầu. Đây không phải hủy bỏ hoàn toàn, nhưng trong thực tế, người dùng muốn chạy inference tối ưu ngay hôm nay sẽ không có CPX để dùng. Một tín hiệu tích cực ngoài lề: việc hủy CPX giải phóng đáng kể capacity sản xuất GDDR7, loại bộ nhớ đang được dùng cho RTX 5090. Nguồn cung GDDR7 thoáng hơn đồng nghĩa với áp lực giá card đồ họa cao cấp giảm theo.

Groq LPU – công nghệ thay thế và ý nghĩa với inference

Trong khi chip này bị hoãn, Rubin LPX tray với Groq LPU đang được hãng đẩy mạnh như giải pháp inference thế hệ mới. Điểm khác biệt cốt lõi nằm ở kiến trúc: thay vì dùng DRAM truyền thống, Groq LPU xây dựng toàn bộ trên SRAM tĩnh, loại bộ nhớ nhanh hơn nhiều lần so với DRAM nhưng chi phí sản xuất cao và dung lượng thấp hơn. Chính đặc điểm này khiến LPU phù hợp tuyệt đối cho decode nhưng không thể thay thế GPU trong các tác vụ training hay prefill nặng.

Kết quả của kiến trúc SRAM là băng thông cực kỳ ấn tượng: mỗi chip LPU đơn lẻ đạt 150 TB/s, và khi gộp toàn rack lại con số đó nhảy lên 640 TB/s. So sánh để có cảm nhận: H100 SXM5 của NVIDIA chỉ đạt khoảng 3.35 TB/s băng thông bộ nhớ HBM3. Đây là lý do Groq LPU vượt trội trong decode, giai đoạn cần đọc trọng số mô hình liên tục để sinh ra từng token.

Nhìn rộng hơn, đây là dấu hiệu thị trường inference đang trưởng thành. Không còn là bài toán “chip nào mạnh nhất” mà là “chip nào phù hợp với từng giai đoạn của pipeline”. Prefill và decode có yêu cầu khác nhau hoàn toàn, và ngành chip AI đang bắt đầu tối ưu theo chiều sâu đó.

Để hiểu rõ hơn về chiến lược AI chip của hãng, bài về NVIDIA RTX PRO 4500 Blackwell Server Edition và bài về

máy chủ AI Nvidia GB300 thống trị 2026 cho thấy bức tranh toàn cảnh về hệ sinh thái Rubin đang được xây dựng.