NVIDIA Rubin Google đang là một trong những thông tin đáng chú ý nhất của tuần khi Google xác nhận hạ tầng A5X mới có thể mở rộng tới 80.000 GPU Rubin trong một cụm và 960.000 GPU trên cụm đa site. Đây không chỉ là màn phô diễn thông số, mà là dấu hiệu cho thấy các hãng cloud đang cố biến AI thành dịch vụ công nghiệp. Khi nhiều trung tâm dữ liệu được ghép lại thành một cụm logic, doanh nghiệp có thể chạy workload lớn hơn mà không bị bó buộc bởi giới hạn của một site đơn lẻ. Với thị trường AI cloud, mốc gần một triệu GPU quan trọng vì nó phản ánh ai đang đủ mạng, điện và phần mềm cho các bài toán AI lớn.

A5X, Vera Rubin và cụm đa site thực ra là gì?

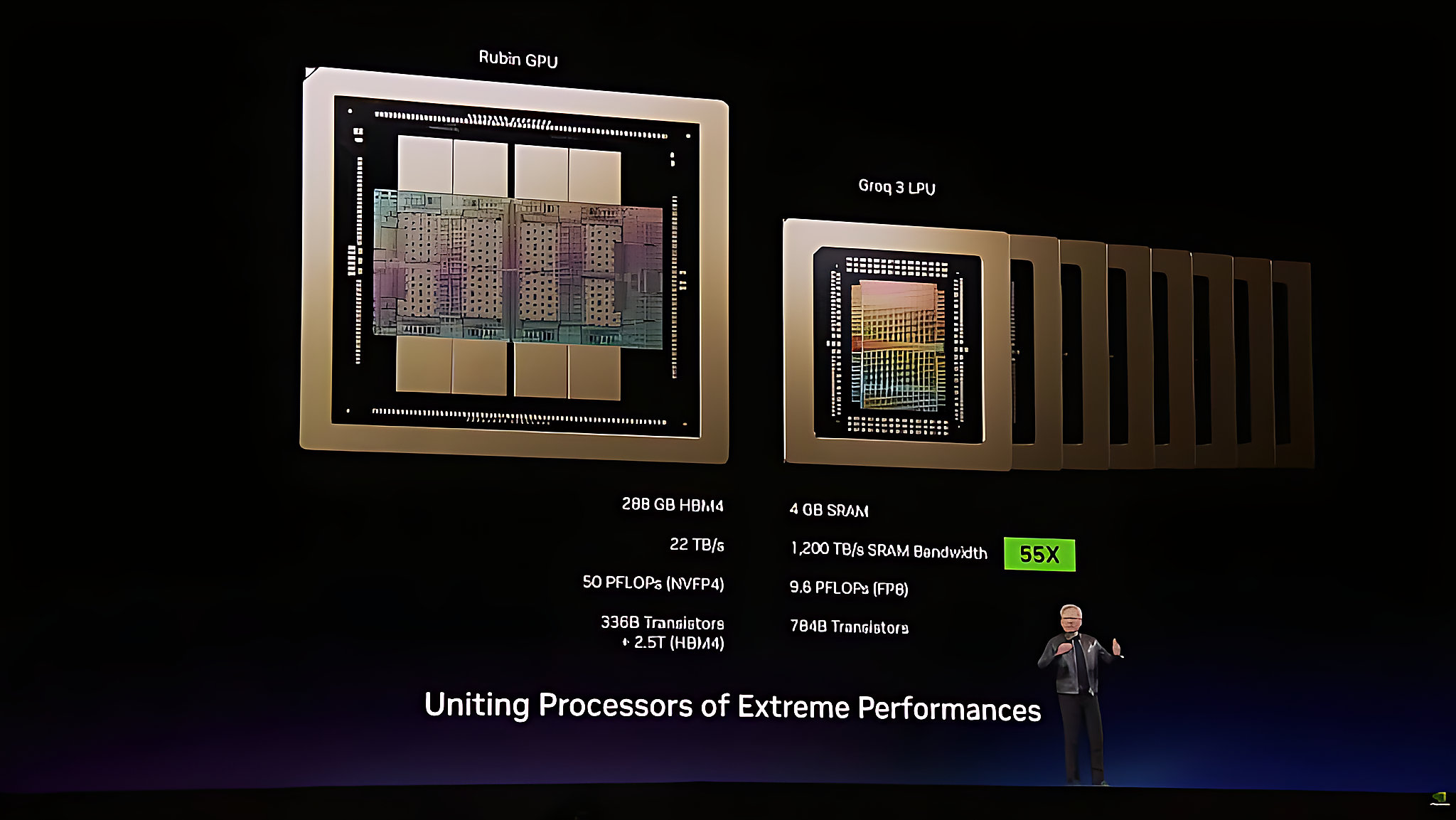

Theo bài phân tích của Wccftech, A5X là lớp máy ảo AI mới của Google, còn Vera Rubin là thế hệ GPU kế nhiệm Blackwell mà Google dự kiến đưa lên cloud sớm. Điểm khác biệt là A5X đi cùng mạng ConnectX-9 của NVIDIA và lớp kết nối Virgo của Google để liên kết nhiều rack, nhiều cụm, thậm chí nhiều địa điểm thành một hệ thống logic thống nhất hơn. Nói ngắn gọn, multi-site cluster là cách gom tài nguyên từ nhiều trung tâm dữ liệu để một bài toán AI lớn vẫn nhìn thấy một siêu cụm duy nhất. NVIDIA Rubin Google vì vậy không chỉ là chuyện GPU mới, mà là cách Google nâng quy mô phân phối sức mạnh AI trên cloud.

Con số 80.000 GPU cho một cụm đơn và 960.000 GPU cho cụm đa site đáng chú ý vì mô hình lớn không chỉ cần chip nhanh, mà còn cần các chip trao đổi dữ liệu đủ hiệu quả để không bị nghẽn. Đây là bước đi tiếp theo sau giai đoạn thị trường tập trung vào NVIDIA Blackwell, nhưng ở quy mô hạ tầng lớn hơn nhiều. Khi cloud ghép được tài nguyên ở nhiều site, họ có thêm dư địa để nhận các dự án huấn luyện và suy luận khổng lồ mà trước đây dễ vướng trần điện năng hoặc mặt bằng.

Vì sao mốc gần một triệu GPU lại làm nóng cuộc đua AI cloud?

Trong công bố hợp tác mới giữa Google và NVIDIA, hãng chip cho biết A5X có thể giảm chi phí suy luận trên mỗi token và tăng thông lượng trên mỗi megawatt so với thế hệ trước. Nếu lợi ích đó giữ được khi mở rộng ra cụm cực lớn, dịch vụ AI có thể rẻ hơn, phản hồi nhanh hơn và bớt nghẽn hơn khi số người dùng tăng mạnh. Với doanh nghiệp, đây là khác biệt giữa một bản demo và một dịch vụ thật có doanh thu. NVIDIA Rubin Google vì thế đáng chú ý không chỉ vì gần một triệu GPU nghe choáng ngợp, mà vì nó phản ánh cuộc đua cloud đang chuyển sang hiệu quả vận hành.

| Thành phần | Dữ kiện chính | Ý nghĩa |

|---|---|---|

| A5X | Máy ảo AI mới của Google | Đưa GPU Rubin lên cloud ở quy mô lớn |

| Vera Rubin | GPU kế nhiệm Blackwell | Phục vụ workload AI nặng hơn |

| Virgo + ConnectX-9 | 80.000 GPU một cụm, 960.000 GPU đa site | Giảm rủi ro nghẽn khi mở rộng |

| Mục tiêu | 10x chi phí token thấp hơn, 10x thông lượng trên mỗi megawatt | AI cloud có lợi hơn về giá và tốc độ |

Tác động rộng hơn nằm ở chỗ Google không chỉ dựa vào TPU tự phát triển, mà sẵn sàng đưa cả Rubin vào cùng một chiến lược hạ tầng. Điều này khiến cuộc đua AI cloud trực diện hơn với AWS, Microsoft, Oracle và cả những bên đang tối ưu CPU lẫn mạng cho AI như câu chuyện Meta AWS Graviton. Khi nhà cung cấp nào cũng nói về agentic AI, thứ quyết định hợp đồng lớn có thể không còn là model demo đẹp hơn, mà là ai bảo đảm được cụm máy đủ lớn và đủ tiết kiệm điện để khách hàng chạy liên tục.

Người dùng phổ thông sẽ không thuê một cụm 960.000 GPU, nhưng vẫn chịu tác động gián tiếp từ những bước đi như vậy. Nếu Google thực sự biến NVIDIA Rubin Google thành hạ tầng sẵn sàng cho dịch vụ quy mô công nghiệp, tốc độ ra mắt tính năng AI mới có thể nhanh hơn và giá dịch vụ có thể dễ chịu hơn. Mốc gần một triệu GPU vì thế đáng chú ý không phải vì nó phô trương kích thước, mà vì nó cho thấy cuộc đua AI đã chuyển sang bài toán vận hành hạ tầng.