NVIDIA Nemotron 3 Nano Omni cho thấy cuộc đua agent AI đang chuyển từ chuyện model giỏi hơn sang chuyện hệ thống chạy nhanh hơn và rẻ hơn. Với một tác vụ phải nghe âm thanh, đọc tài liệu, nhìn ảnh chụp màn hình rồi trả lời bằng ngôn ngữ tự nhiên, cách ghép nhiều model riêng lẻ thường khiến độ trễ tăng mạnh. NVIDIA đang chọn lối đi khác: gom audio, video, ảnh và text vào cùng một pipeline để giảm số bước suy luận trung gian. Với doanh nghiệp, khác biệt này chạm thẳng vào chi phí vận hành, không chỉ là một con số benchmark để trình diễn.

Một model hợp nhất thay đổi bài toán chi phí của agent AI ra sao?

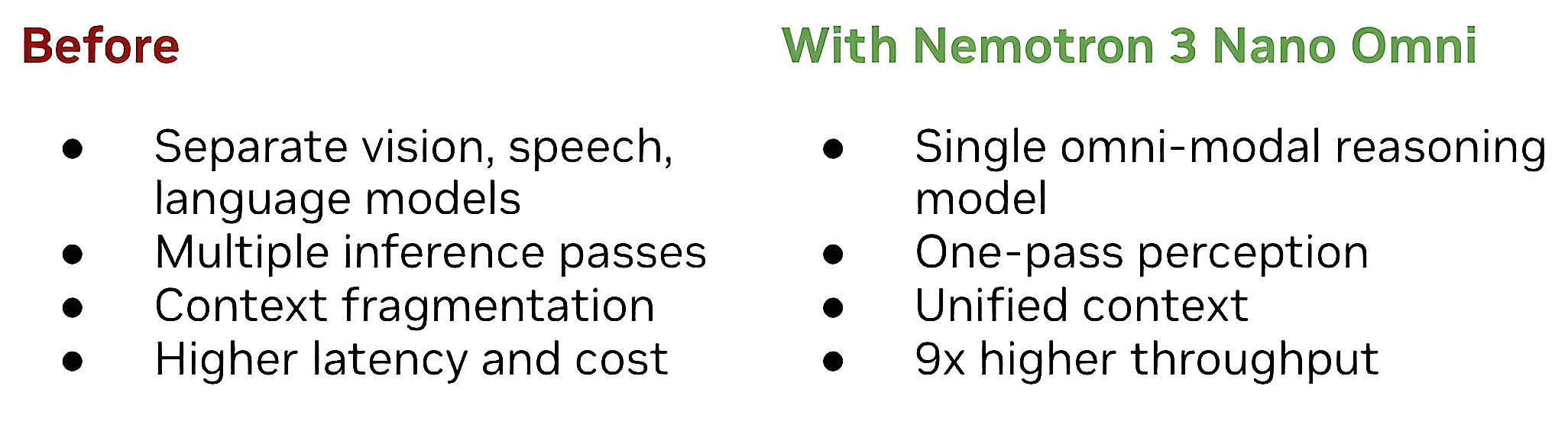

Theo NVIDIA Nemotron 3 Nano Omni, đây là mô hình omni-modal mở có kiến trúc hybrid MoE 30B-A3B, hỗ trợ ngữ cảnh 256K và được định vị như lớp “mắt và tai” cho hệ thống agent. Thay vì đẩy ảnh sang model thị giác, âm thanh sang model giọng nói rồi mới chuyển tiếp sang model ngôn ngữ để kết luận, mô hình này xử lý nhiều loại dữ liệu trong cùng một dòng ngữ cảnh. Càng ít khâu trung gian, độ trễ càng thấp và ngân sách inference càng dễ kiểm soát.

Wccftech cho biết NVIDIA Nemotron 3 Nano Omni có thể mang lại thông lượng agent AI cao hơn tới 9 lần so với các open omni model khác ở cùng mức độ tương tác. Nếu mức tăng này giữ được khi đi vào sản phẩm thật, đội ngũ AI sẽ có hai lợi ích dễ thấy: cùng lượng phần cứng nhưng phục vụ được nhiều phiên làm việc hơn, và vẫn giữ phản hồi đủ nhanh khi agent phải xem màn hình, nghe cuộc gọi hay đọc tài liệu có cả biểu đồ lẫn hình ảnh.

Ý nghĩa này càng rõ khi đặt cạnh xu hướng mở rộng NVIDIA Blackwell và hạ tầng AI chuyên dụng. Phần cứng mạnh chỉ giải quyết một nửa bài toán; nửa còn lại là có model nào đủ gọn để tận dụng tài nguyên đó mà không kéo chi phí vận hành tăng theo cấp số nhân. NVIDIA Nemotron 3 Nano Omni vì thế đáng chú ý ở đúng chỗ doanh nghiệp quan tâm nhất: hiệu quả trên mỗi lượt suy luận.

Foxconn, Palantir và Oracle nhìn thấy gì từ mô hình này?

Danh sách doanh nghiệp đã dùng hoặc đang đánh giá mô hình này nói khá rõ về hướng đi thị trường. Trong bài công bố, Foxconn, Palantir và Oracle được nêu như những bên đang áp dụng hoặc thử nghiệm Nemotron 3 Nano Omni, bên cạnh Dell Technologies hay DocuSign. Đây không phải nhóm khách hàng cần chatbot trả lời cho vui; họ cần agent hiểu giao diện phần mềm, đọc hồ sơ trộn văn bản với hình ảnh, hoặc nối được dữ liệu nghe nhìn vào quy trình phân tích doanh nghiệp.

| Yếu tố | Nemotron 3 Nano Omni mang lại | Tác động thực tế |

|---|---|---|

| Dữ liệu đầu vào | Ảnh, video, audio, tài liệu, bảng biểu | Giảm nhu cầu ghép nhiều model rời |

| Hiệu quả xử lý | Thông lượng cao hơn tới 9 lần | Phục vụ nhiều agent hơn trên cùng hạ tầng |

| Chi phí | Ít bước suy luận trung gian hơn | Dễ kiểm soát ngân sách inference hơn |

| Triển khai | Open model, từ edge tới cloud | Hợp với dữ liệu nội bộ và yêu cầu tuân thủ |

Điểm hay là NVIDIA Nemotron 3 Nano Omni không cố thay toàn bộ kiến trúc agent, mà đóng vai perception sub-agent để phối hợp với model lập kế hoạch hoặc model hành động ở lớp trên. Cách tiếp cận này thực tế hơn nhiều so với kỳ vọng một model duy nhất làm tất cả mọi thứ. Nó cũng ăn khớp với xu hướng hạ tầng AI đang nóng lên trên thị trường, từ các cụm GPU khổng lồ tới những nền tảng tối ưu suy luận như bài NVIDIA Rubin mà laptopspot.vn vừa đề cập.

Với NVIDIA Nemotron 3 Nano Omni, ý nghĩa lớn nhất nằm ở việc biến “đa phương thức” từ khái niệm trình diễn thành bài toán kinh doanh rõ ràng hơn. Nếu một agent vừa nhìn, vừa nghe, vừa đọc mà vẫn giữ được tốc độ phản hồi chấp nhận được, doanh nghiệp sẽ có thêm lý do để đưa AI vào hỗ trợ khách hàng, kiểm tra chứng từ, giám sát video hay thao tác phần mềm nội bộ. Trong thị trường agent AI, bước tiến đáng giá nhiều khi không phải model thông minh hơn bao nhiêu, mà là làm cùng công việc với ít độ trễ và ít chi phí hơn.