AMD MI450 đã bắt đầu được gửi mẫu cho nhóm khách hàng đầu tiên, trong khi MI500 dù còn ở thế hệ kế tiếp cũng đã sớm được hỏi mua cho các cụm AI inference quy mô lớn. Theo bài gốc của WCCFtech, AMD cho biết nhu cầu hiện tại đã vượt kế hoạch nội bộ mà hãng từng đặt cho năm 2027. Chi tiết này cho thấy thị trường AI không còn chỉ chạy theo chip nhanh hơn, mà đang nhìn vào năng lực triển khai thực tế. Với người theo dõi hạ tầng AI, đây là tín hiệu AMD muốn bước vào cuộc chơi rack AI trọn gói thay vì chỉ bán GPU rời.

MI450 và MI500 cho thấy AMD không còn muốn chỉ là phương án thay thế

Trong phần trao đổi về kết quả kinh doanh quý I/2026, Lisa Su xác nhận AMD đã bắt đầu sample AMD MI450 cho các khách hàng dẫn đầu và vẫn giữ mốc tăng tốc giao hệ Helios trong nửa cuối năm nay. Quan trọng hơn, AMD nói dự báo từ nhóm khách hàng đầu tiên đã vượt kế hoạch ban đầu và còn xuất hiện thêm các cơ hội triển khai ở quy mô nhiều gigawatt. Điều đó cho thấy hãng đang cố chuyển từ vị thế có sản phẩm cạnh tranh sang vị thế có khách hàng sẵn sàng đặt hạ tầng thật.

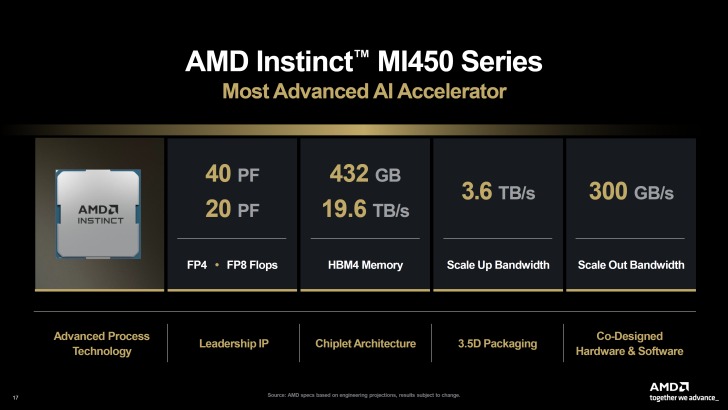

Slide thông số trong cùng bài viết cho thấy MI450 được AMD quảng bá với 40 PFLOPs FP8, 432 GB HBM4, băng thông bộ nhớ 19,6 TB/s và băng thông scale-out 300 GB/s mỗi GPU. Với AI vận hành ở quy mô lớn, những thông số này có ý nghĩa trực tiếp: mô hình có nhiều dữ liệu nằm sẵn trong bộ nhớ hơn, truy cập nhanh hơn và bớt nghẽn hơn khi phục vụ đồng thời nhiều phiên làm việc.

Điểm cần chú ý là AMD đang bán câu chuyện theo kiểu rack-scale, tức đi cùng chip là cả cách ghép thành cụm và mở rộng hệ thống. Cách tiếp cận đó rất gần với hướng thị trường đang quan tâm trong các phân tích về rack AI của Nvidia Feynman, nơi điện, mạng và làm mát ngày càng ảnh hưởng mạnh đến giá trị thực của một nền tảng AI.

Vì sao AI inference đang thành điểm nóng mới của thị trường chip AI

Tuyên bố đáng chú ý nhất từ AMD là các triển khai lớn nhất mà hãng đang thấy cho MI450 lại nghiêng về inference thay vì training. Đây là thay đổi quan trọng, vì sau giai đoạn đổ tiền để huấn luyện mô hình nền, nhiều công ty giờ phải tối ưu khâu đưa AI vào phục vụ người dùng và ứng dụng doanh nghiệp mỗi ngày. Lúc này, thứ quyết định chi phí không chỉ là tốc độ huấn luyện, mà là một rack xử lý được bao nhiêu truy vấn với mức điện năng nào.

| Điểm theo dõi | MI450 | Tín hiệu từ MI500 |

|---|---|---|

| Trạng thái | Đã bắt đầu sample | Đã có khách hàng làm việc sớm |

| Tín hiệu cầu | Vượt kế hoạch nội bộ ban đầu | Khách mua chuẩn bị cho chu kỳ kế tiếp |

| Ý nghĩa với inference | Nhắm vào triển khai lớn từ 2026 | Cho thấy nhu cầu không chỉ ngắn hạn |

Xu hướng này cũng giải thích vì sao cuộc đua bộ nhớ đang nóng lên. Inference với mô hình lớn đòi hỏi dữ liệu được nạp và luân chuyển liên tục, nên dung lượng HBM4 và băng thông bộ nhớ trở thành lợi thế rất thực tế. Đó cũng là lý do các tín hiệu quanh bộ nhớ HBM4 đang được theo dõi sát, vì nếu nghẽn ở lớp bộ nhớ thì rất khó mở rộng AI inference một cách hiệu quả.

Việc khách hàng đã sớm làm việc với MI500 còn cho thấy chu kỳ mua hạ tầng AI đang bị kéo về sớm hơn. Các hãng vận hành datacenter không chỉ muốn biết AMD MI450 nhanh đến đâu ở thế hệ hiện tại, mà còn cần một roadmap đủ rõ để lên kế hoạch điện, mạng và ngân sách cho vài năm tiếp theo. Nếu đà này giữ nguyên, AI inference có thể sẽ là mặt trận khiến cuộc đua giữa AMD và Nvidia căng hơn nhiều trong giai đoạn 2026-2027. Điểm đáng chú ý là HBM4 không còn là thông số phụ, mà đang thành biến số quyết định hiệu quả triển khai thật.