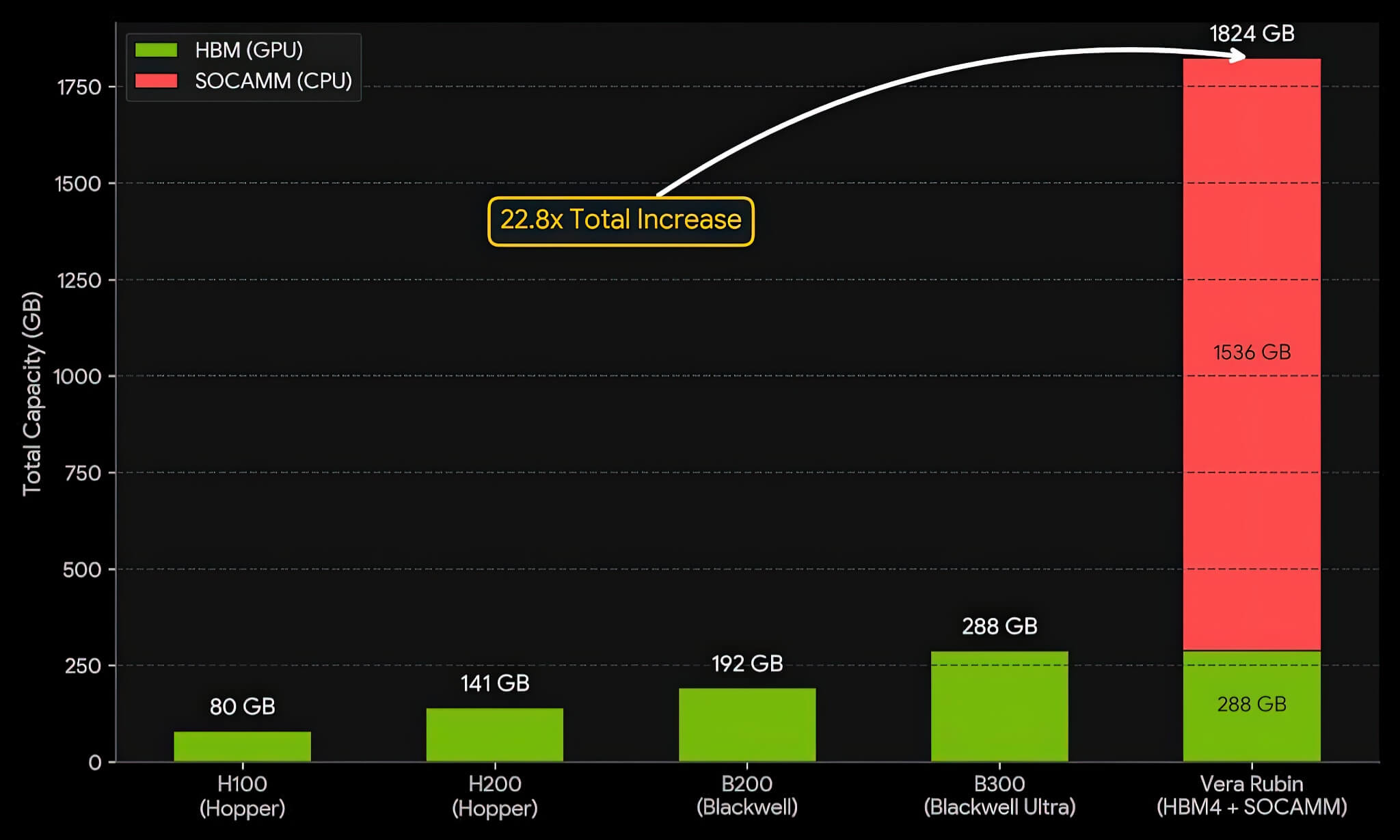

Dell vừa đưa ra một cảnh báo đáng chú ý cho thị trường AI: nhu cầu bộ nhớ cho AI có thể tăng tới mức rất khó hình dung vào năm 2028, và đây không còn là câu chuyện riêng của các hãng làm chip. Khi bộ nhớ AI trở thành nút thắt lớn hơn, giá bộ nhớ AI cũng là biến số mà doanh nghiệp phải theo dõi sát. Không chỉ vậy, bộ nhớ AI giờ đã thành một chỉ dấu rõ về mức đội vốn của cả hệ thống. Khi bộ nhớ trên từng accelerator tiếp tục phình to, còn quy mô cụm máy AI cũng tăng cùng lúc, bài toán chi phí sẽ lan từ hyperscaler sang cả doanh nghiệp mua hạ tầng. Michael Dell ước tính tổng nhu cầu bộ nhớ cho AI có thể tăng khoảng 625 lần nếu hai xu hướng đó tiếp diễn song song. Với người theo dõi phần cứng, chi tiết đáng đọc nhất không nằm ở câu nói mạnh, mà ở tín hiệu cho thấy nút thắt memory có thể kéo dài thêm nhiều năm.

Vì sao cảnh báo của Michael Dell đáng để theo dõi ngay từ bây giờ?

Theo lập luận được Michael Dell chia sẻ, nhu cầu bộ nhớ không tăng chỉ vì mô hình AI lớn hơn. Điều này cũng giải thích vì sao giá bộ nhớ AI có thể còn neo cao lâu hơn dự đoán của nhiều bên mua hạ tầng. Nếu nhu cầu tiếp tục phình ra, bộ nhớ AI và giá bộ nhớ AI sẽ còn bị nhắc tới nhiều hơn trong các kế hoạch đầu tư từ nay tới 2028. Với các doanh nghiệp triển khai cụm máy mới, bộ nhớ AI và giá bộ nhớ AI gần như chắc chắn sẽ là hai chỉ số phải theo dõi song song. Vấn đề là hai biến số đang phình ra cùng lúc: lượng bộ nhớ gắn trên từng accelerator ngày càng cao, và số accelerator trong mỗi hệ thống AI cũng tăng mạnh. Khi hai lớp mở rộng này cộng hưởng, tổng cầu bộ nhớ không còn tăng theo đường thẳng mà thành cú nhảy cấp số lớn. Ước tính 625 lần vì thế trở thành một cách diễn đạt dễ hiểu cho điều mà các nhà vận hành hạ tầng phải chuẩn bị từ bây giờ: mỗi đợt nâng cấp AI về sau sẽ ngốn nhiều memory hơn rất nhiều so với thế hệ trước.

Điều này đặc biệt đáng chú ý vì memory không thể mở rộng nguồn cung nhanh như GPU hay CPU ở góc nhìn thương mại ngắn hạn. Một dây chuyền mới, một lớp đóng gói mới hay một thế hệ HBM mới đều cần thời gian để tăng sản lượng ổn định. Trong lúc đó, nhu cầu AI của hyperscaler, cloud provider và doanh nghiệp lớn lại chưa có dấu hiệu chậm lại. Bối cảnh này khá ăn khớp với những gì laptopspot.vn từng ghi nhận ở bài Micron GDDR cho AI, nơi các hãng nhớ bắt đầu tìm thêm kiến trúc mới để đỡ áp lực lên HBM truyền thống.

Thêm một chi tiết đáng chú ý là thời gian kéo dài của các hợp đồng cung ứng. Khi người mua chấp nhận khóa nguồn memory trong nhiều năm thay vì mua theo nhịp quý, thị trường đang phát tín hiệu rằng nỗi lo thiếu hàng không còn là ngắn hạn.

Người mua hạ tầng AI và thị trường chip nhớ sẽ bị tác động ra sao?

Với người mua hạ tầng AI, tác động thực tế nhất là tổng chi phí sở hữu có thể dịch chuyển mạnh về phía bộ nhớ thay vì chỉ dồn vào accelerator. Trước đây, nhiều doanh nghiệp thường nhìn GPU là món đắt nhất trong hệ thống. Nhưng nếu mỗi cụm AI mới đòi hỏi lượng memory lớn hơn nhiều, quyết định đầu tư sẽ phải tính kỹ hơn đến cấu hình bộ nhớ, thời điểm mua và cả rủi ro khan hàng.

Ở phía thị trường chip nhớ, đây là tín hiệu tích cực cho các hãng có năng lực làm DRAM và HBM, nhưng không đồng nghĩa mọi thứ sẽ dễ dàng. Nhu cầu tăng mạnh thường đi kèm áp lực mở rộng công suất, nâng tỷ lệ hàng đạt chuẩn và xử lý bài toán đóng gói tiên tiến. Nếu một mắt xích chậm lại, giá có thể biến động mạnh giống cách thị trường từng phản ứng với giá DDR5 Trung Quốc, chỉ khác là lần này tâm điểm nằm ở bộ nhớ cho AI hơn là RAM phổ thông.

Nhìn rộng hơn, cảnh báo của Dell cho thấy cuộc đua AI từ nay đến 2028 sẽ không chỉ xoay quanh ai có GPU nhanh hơn. Bên thắng còn là bên giữ được nguồn bộ nhớ ổn định, đủ sớm và đủ lâu để không bị trễ nhịp mở rộng hệ thống. Với doanh nghiệp đang cân nhắc đầu tư AI nội bộ, thông điệp đã khá rõ: nếu chờ đến khi nhu cầu bùng nổ rồi mới đi tìm bộ nhớ, chi phí rất có thể sẽ không còn nằm trong vùng dễ chịu nữa. cảnh báo bộ nhớ AI cho thấy áp lực này còn kéo dài nhiều năm.