AMD vượt Intel doanh thu data center lần đầu trong quý I/2026 là một tín hiệu đáng chú ý với thị trường server AI. Theo phân tích của Wccftech, cú bứt lên này diễn ra đúng lúc các hyperscaler không còn chỉ săn GPU, mà bắt đầu gom cả CPU nhanh hơn trước. Điều đó cho thấy cơn sốt AI đang đổi cách xây trung tâm dữ liệu: GPU vẫn là máy tăng tốc chính, nhưng CPU lại là lớp điều phối và cấp dữ liệu cho cả cụm chạy ổn định. Cuộc đua AI vì thế ngày càng được quyết định bởi cả hệ thống server phía sau, thay vì một con chip đơn lẻ.

Vì sao mốc vượt Intel lần này đáng chú ý hơn một con số quý

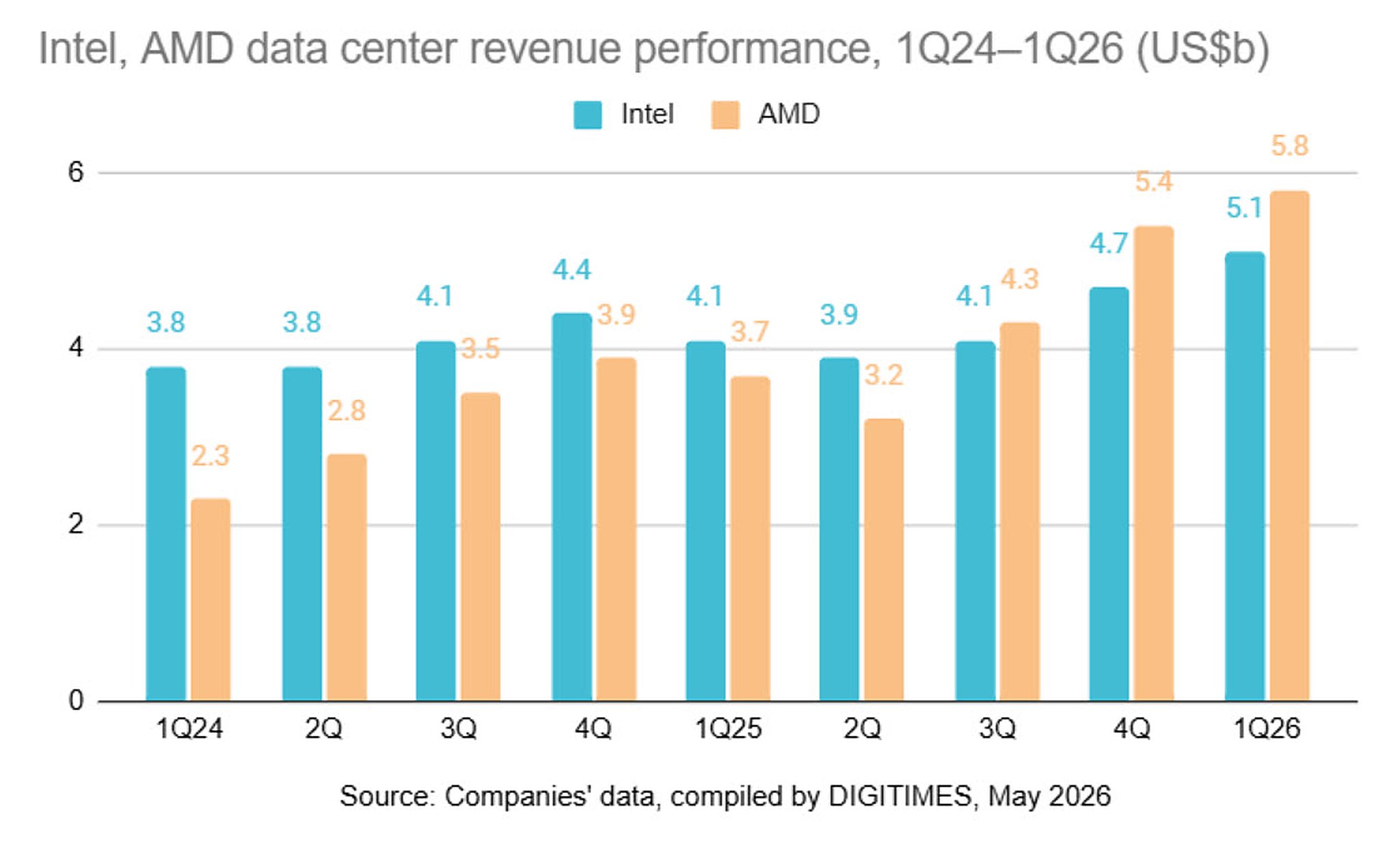

Trong báo cáo tài chính quý I/2026, AMD cho biết doanh thu Data Center đạt 5,8 tỷ USD, tăng 57% so với cùng kỳ năm trước. Mức này cao hơn mảng Data Center and AI của Intel, nơi hãng ghi nhận 5,1 tỷ USD trong cùng quý. Khoảng cách chưa lớn, nhưng ý nghĩa rất rõ: EPYC không còn ở vai trò người bám đuổi, mà đã đủ lực để lấy phần doanh thu cao nhất ở nhóm máy chủ đang nóng nhất vì AI.

Điểm đáng chú ý là lực đẩy này không chỉ đến từ chuyện AMD bán thêm CPU server cao cấp. Khi các cụm AI ngày càng lớn, CPU phải gánh nhiều việc hơn: điều phối tác vụ, cấp dữ liệu cho GPU, quản lý bộ nhớ, lưu trữ và mạng. Wccftech cho biết tỷ lệ CPU trên GPU trong hạ tầng AI đã dịch từ khoảng 1:8 xuống 1:4 và đang tiến dần tới mô hình gần như một GPU đi cùng một CPU, cho thấy phần “hậu cần” của rack giờ đã trở thành phần ngân sách rất thật.

Bối cảnh đó ăn khớp với các thương vụ hạ tầng khổng lồ như bài toán 220.000 GPU Nvidia mà LaptopSpot đã đề cập. Càng nhiều accelerator được kéo vào một cụm, CPU càng phải làm tốt vai trò giữ dữ liệu, mạng và lịch chạy không bị nghẽn. AI càng lớn thì doanh thu từ CPU càng bớt giống phần phụ, và đó là lý do việc AMD vượt Intel doanh thu data center lần này được giới theo dõi hạ tầng nhìn rất kỹ.

Cơn sốt agentic AI đang đổi công thức mua server ra sao

Agentic AI khiến bài toán mua server khác đi vì mô hình không còn chỉ trả lời một lượt rồi dừng. Nó phải chia việc thành nhiều bước, gọi công cụ, truy vấn dữ liệu ngoài và chạy nhiều tiến trình song song trước khi đưa ra kết quả cuối. Chính kiểu vận hành này khiến hyperscaler phải mua thêm CPU để nuôi GPU bằng dữ liệu, giữ độ trễ thấp và tận dụng tốt điện năng trong cả rack.

| Thành phần | Vai trò trong rack AI | Tín hiệu mới từ Q1/2026 | Tác động với hyperscaler |

|---|---|---|---|

| AMD EPYC | CPU host cho cloud và AI server | Doanh thu Data Center của AMD lên 5,8 tỷ USD | Có thêm lựa chọn CPU hiệu năng cao để mở rộng cụm nhanh |

| Intel Xeon | CPU nền tảng truyền thống của data center | Intel Data Center and AI đạt 5,1 tỷ USD | Vẫn giữ quy mô lớn, nhưng áp lực cạnh tranh tăng |

| CPU | Điều phối, cấp dữ liệu, quản lý bộ nhớ và I/O | Tỷ lệ CPU:GPU dịch từ 1:8 về 1:4 | Ngân sách server không còn dồn hết vào accelerator |

| GPU | Tăng tốc huấn luyện và suy luận | Tiếp tục là trung tâm của hạ tầng AI | Muốn khai thác hết hiệu năng thì phải đi cùng CPU và liên kết nhanh hơn |

Ở góc độ kỹ thuật, đây cũng là lý do các nút thắt quanh băng thông và kết nối được soi kỹ hơn trước. Bối cảnh đó giúp giải thích vì sao những chủ đề như PCIe 7.0 cho GPU AI bắt đầu được quan tâm mạnh: nếu đường dữ liệu không theo kịp, số GPU nhiều hơn chưa chắc đổi được thành nhiều token hơn.

Với AMD và Intel, quý I/2026 là một phép thử mới của thị trường. AMD vượt Intel doanh thu data center cho thấy người mua server AI đang trả tiền nhiều hơn cho một hệ thống hoàn chỉnh, nơi CPU, GPU, bộ nhớ và kết nối phải đi cùng nhau. Nếu làn sóng agentic AI tiếp tục tăng trong nửa cuối năm 2026, câu hỏi tiếp theo sẽ là ai giao được đủ cả rack để tạo ra giá trị thật.