NVIDIA V100 đang tạo ra một nghịch lý đáng chú ý trên thị trường phần cứng cũ: mẫu GPU trung tâm dữ liệu ra mắt từ năm 2017, nay có giá chỉ khoảng 100 USD cho bản 16 GB, lại vượt một số card phổ thông mới hơn trong tác vụ chạy mô hình ngôn ngữ lớn. Điểm đáng nói không nằm ở chuyện card cũ thắng card mới, mà ở bài học rất thực tế về bộ nhớ, băng thông và chi phí trên hiệu năng. Khi AI inference dần trở thành nhu cầu của người dùng cá nhân, những GPU cũ nhưng có cấu hình đúng bài toán vẫn còn đất sống. Vì thế, câu chuyện này đáng chú ý hơn một màn hoài niệm phần cứng.

Vì sao Tesla V100 cũ vẫn chạy AI LLM tốt hơn nhiều card consumer?

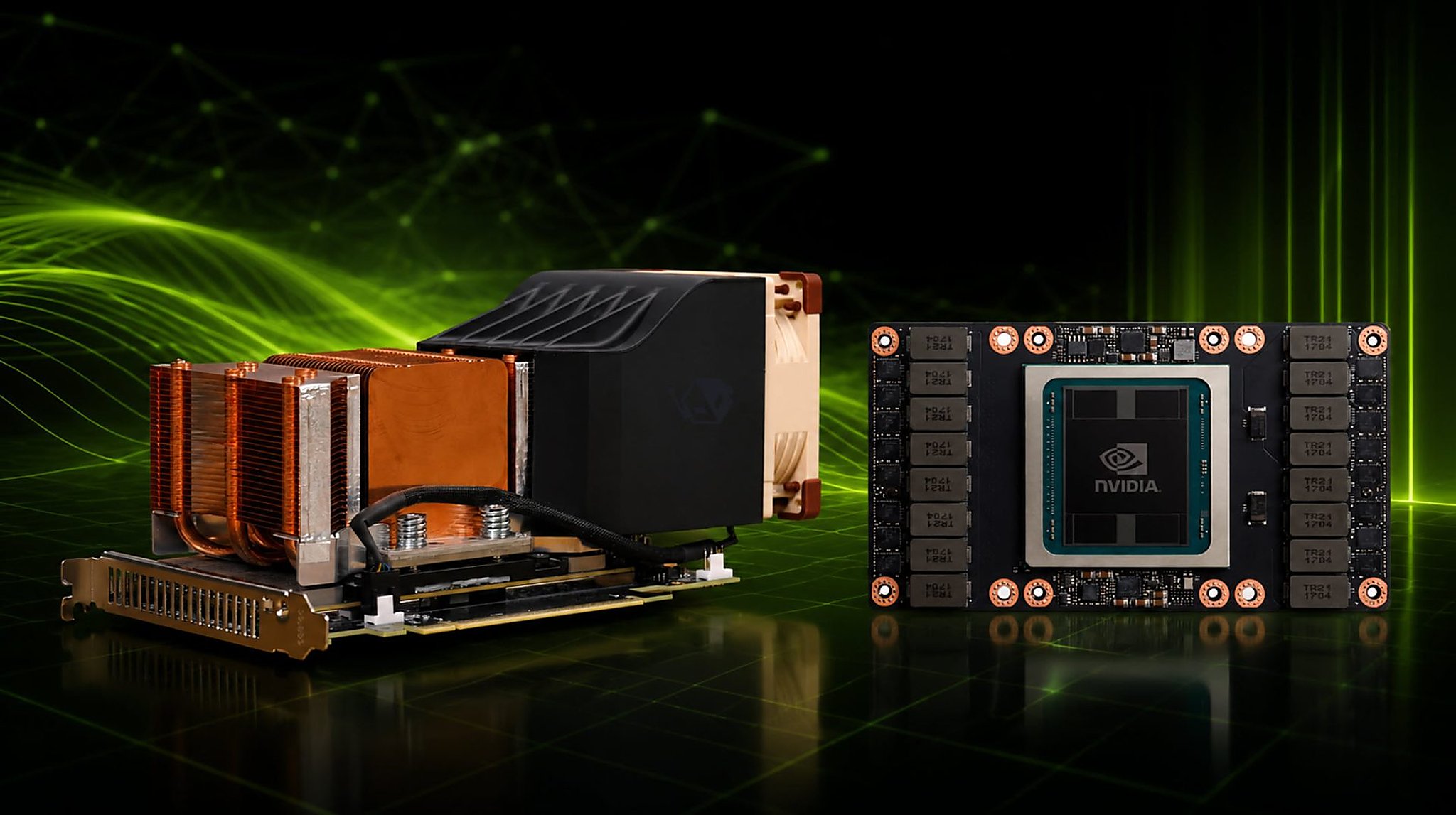

Trong thử nghiệm của Hardware Haven, chiếc Tesla V100 dạng SXM2 được gắn qua adapter PCIe và vượt cả RX 7800 XT lẫn RTX 3060 ở một số bài test LLM. NVIDIA V100 có 640 Tensor Core, bộ nhớ HBM2 16 GB hoặc 32 GB, bus 4096-bit và băng thông tới 898 GB/giây. Với AI inference, đó là những thông số đúng việc: mô hình ngôn ngữ liên tục đọc trọng số từ bộ nhớ, nên tốc độ truy xuất và dung lượng VRAM thường quan trọng hơn hiệu năng đồ họa.

Thử nghiệm GPT-oss 20B cho thấy hệ thống dùng NVIDIA V100 đạt khoảng 130 token/giây, trong khi RX 7800 XT dừng quanh 90 token/giây. Ở bài Gemma4:e4b chạy với ollama và openwebui, mẫu GPU này còn nhanh hơn RTX 3060 12 GB khoảng 42% về tốc độ sinh token. Chênh lệch đó cho thấy trong AI, card chơi game không phải lúc nào cũng thắng chỉ vì mới hơn.

Một điểm quan trọng khác là VRAM. RTX 3060 có 12 GB, RX 7800 XT có 16 GB GDDR6, còn NVIDIA V100 dùng HBM2 với 16 GB hoặc 32 GB tùy bản. Khi mô hình phình lên, bộ nhớ không chỉ quyết định có chạy được hay không mà còn ảnh hưởng trực tiếp tới việc có phải chia tải hoặc đẩy dữ liệu qua RAM hệ thống hay không. Đó cũng là lý do các bài viết gần đây của LaptopSpot về GPU AI ngày càng nhấn mạnh bộ nhớ là nút thắt lớn.

Bài học thực chiến: AI inference cần bộ nhớ và chi phí hợp lý hơn là chạy theo đời GPU

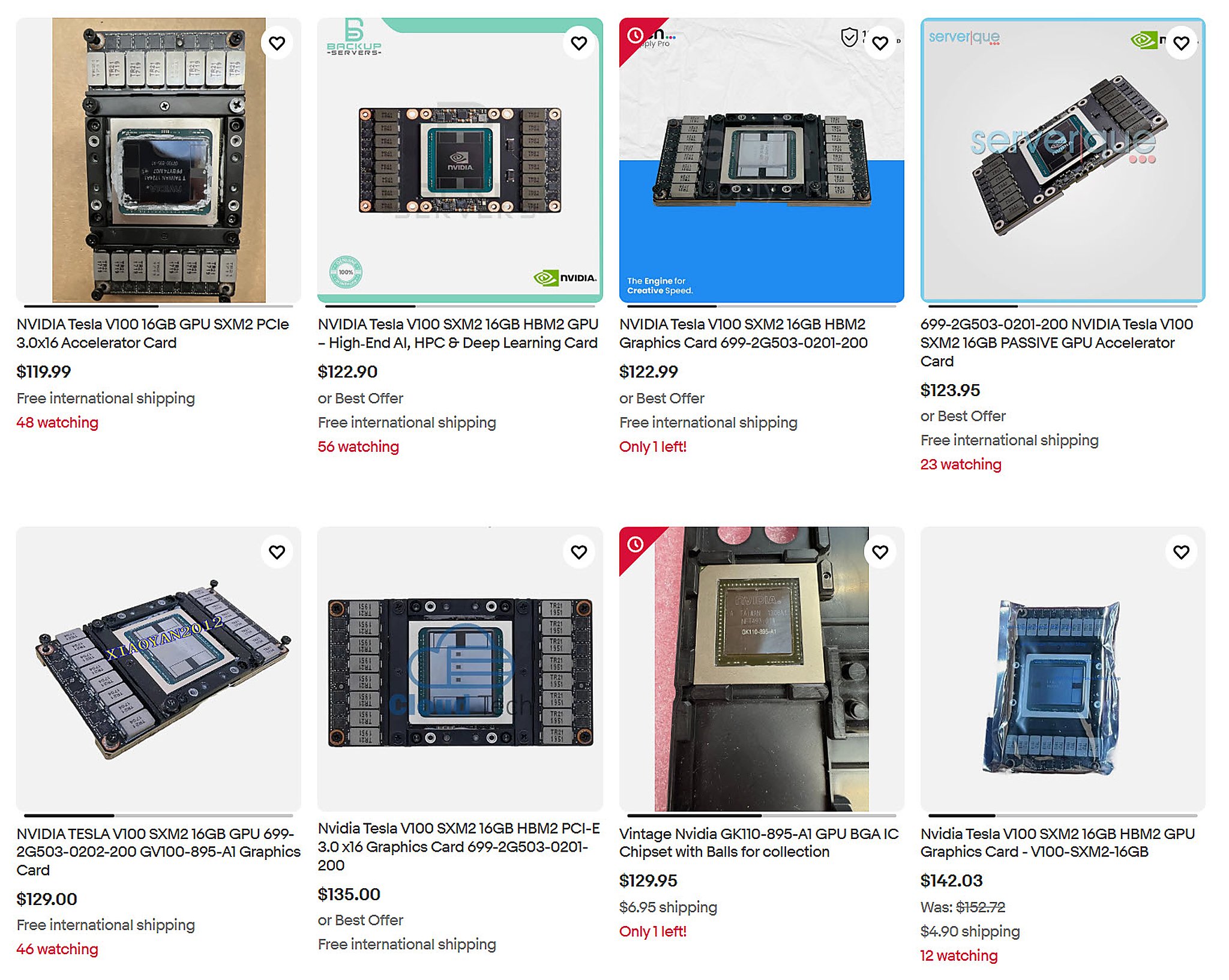

Điểm khiến nhiều người chú ý nhất là giá. Wccftech dẫn lại mức khoảng 100 USD cho bản V100 16 GB hàng cũ trên eBay, nhưng để chạy được trên PC thường còn cần adapter SXM2 sang PCIe, quạt và phụ kiện nguồn. Tổng chi phí thực tế của bộ thử nghiệm vào khoảng hơn 200 USD, vẫn thấp hơn đáng kể nếu mục tiêu là dựng một máy chỉ để chạy AI inference tại chỗ.

| GPU | Bộ nhớ | Kết quả được nêu | Điểm đáng chú ý |

|---|---|---|---|

| Tesla V100 16 GB | HBM2 16 GB, 898 GB/s | Khoảng 130 token/giây với GPT-oss 20B | Giá card cũ thấp, hợp AI hơn game |

| RTX 3060 12 GB | GDDR6 12 GB | Thua V100 khoảng 42% ở Gemma4:e4b | Dễ dùng hơn, nhưng ít lợi thế bộ nhớ |

| RX 7800 XT 16 GB | GDDR6 16 GB | Khoảng 90 token/giây với GPT-oss 20B | Mạnh cho game, chưa chắc tối ưu cho LLM |

Hiệu quả điện cũng không tệ như nhiều người tưởng. Ở bài Gemma4:e4b, V100 còn nhỉnh hơn RTX 3060 khoảng 12% về token trên mỗi watt; khi giới hạn công suất, mức chênh này còn nới ra khoảng 41%. Điều đó cho thấy kiến trúc hướng AI cộng với băng thông bộ nhớ lớn vẫn có thể bù lại khoảng cách thế hệ trong những khối việc rất cụ thể.

Tất nhiên, đây không phải lựa chọn dành cho số đông. Tesla V100 dạng SXM2 không cắm thẳng vào PC phổ thông và cần độ chế. Nhưng với người đang cân nhắc một máy chạy mô hình tại chỗ giá vừa phải, nên nhìn vào VRAM, băng thông và tổng chi phí để đạt số token mong muốn. Xu hướng đó cũng ăn khớp với bài toán hạ tầng AI, nơi bộ nhớ và cách cấp dữ liệu cho GPU ngày càng quyết định hiệu quả thật sự.

Nói ngắn gọn, NVIDIA V100 cho thấy phần cứng cũ vẫn có giá trị nếu nó sở hữu đúng tài nguyên mà mô hình cần. Trong AI inference, một GPU trung tâm dữ liệu cũ với HBM2 rộng và nhiều VRAM vẫn có thể là món hời đáng cân nhắc.