Google được cho là đang bàn với Marvell về một kế hoạch TPU theo hướng tách làm hai chip, và đây là chi tiết đáng chú ý hơn vẻ ngoài rất kỹ thuật của nó. Điểm mấu chốt không phải thêm một con chip cho hoành tráng, mà là giảm nút thắt bộ nhớ khi AI phải trả lời người dùng liên tục. Đó là giai đoạn AI inference, tức lúc mô hình tạo phản hồi thay vì lúc được huấn luyện. Khi thị trường bắt đầu quan tâm nhiều hơn tới chi phí phục vụ hàng triệu truy vấn mỗi ngày, tin đồn này có thể báo hiệu một hướng đi mới cho chip AI chuyên dụng.

TPU hai chip là gì và vì sao Google có thể cần thêm Marvell

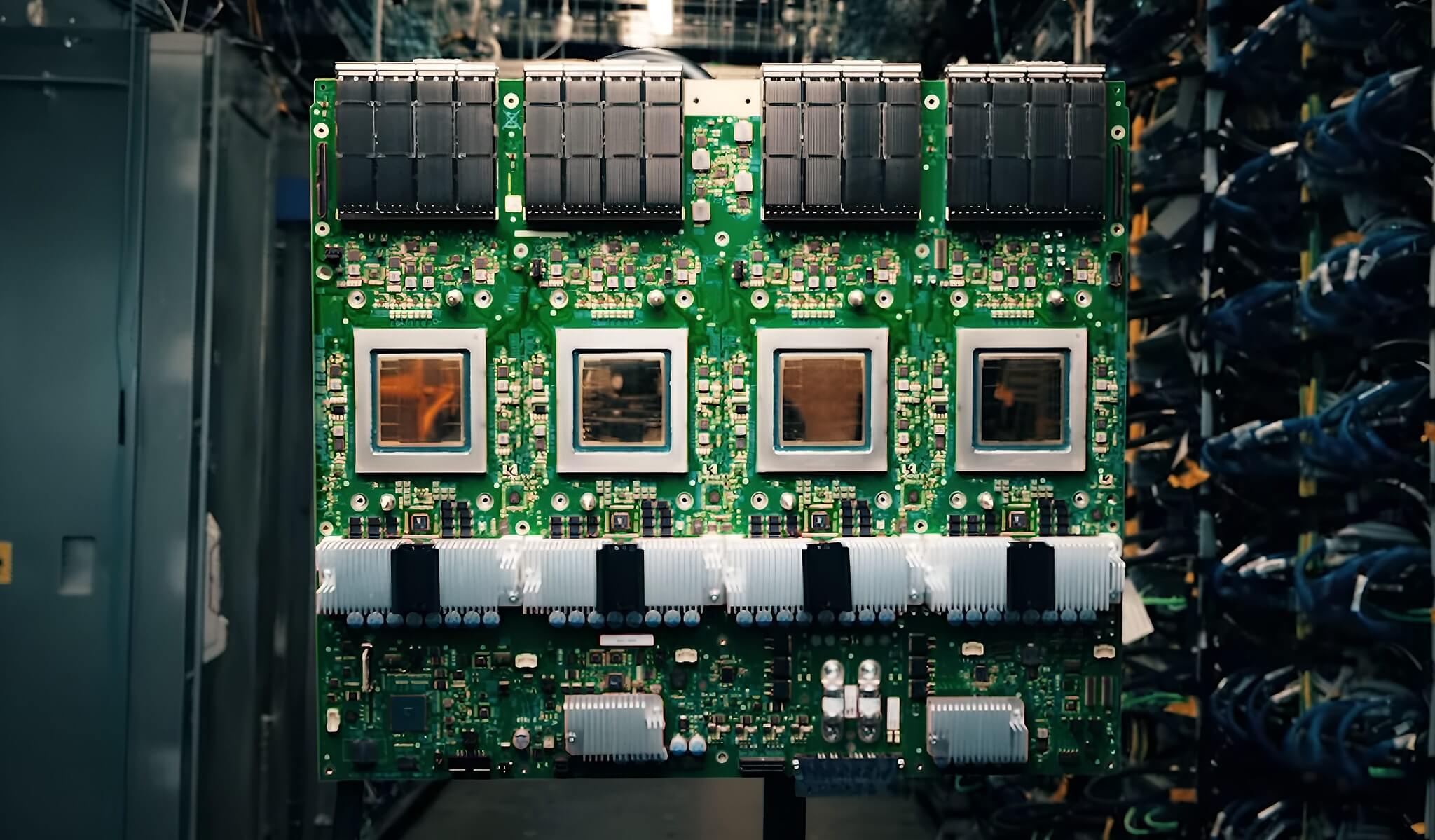

Theo bài nguồn của, dẫn lại thông tin từ The Information, Google đang thảo luận với Marvell về hai hướng chip: một bộ xử lý bộ nhớ đi kèm TPU hiện có và một TPU mới tối ưu riêng cho AI inference. Đây vẫn là thông tin được dẫn từ nguồn thạo tin, chưa phải sản phẩm thương mại đã được Google công bố hoàn tất.

Nói đơn giản, TPU hai chip là cách tách bớt gánh nặng khỏi chip chính. Thay vì để TPU vừa tính toán vừa lo kéo dữ liệu qua lại, Google có thể ghép thêm một chip chuyên xử lý phần bộ nhớ hoặc luồng dữ liệu để giảm độ trễ. Với mô hình ngôn ngữ lớn, đây là khác biệt rất thực tế vì tiền không chỉ nằm ở phép tính, mà còn ở tốc độ đọc, ghi và di chuyển dữ liệu.

Marvell xuất hiện hợp lý vì hãng có kinh nghiệm với custom silicon cho trung tâm dữ liệu, nhất là các khối kết nối và xử lý chuyên dụng. Nếu Google muốn đẩy TPU sang kiến trúc module hơn, nơi từng khối đảm nhiệm một việc rõ ràng, Marvell có thể giúp Google đi nhanh hơn so với việc chỉ phóng to một khuôn chip qua từng thế hệ.

Tài liệu TPU7x cũng cho thấy lý do tin đồn này nghe có cơ sở. Ironwood đã được tối ưu cho training lẫn decode-heavy inference, với 192 GB HBM và hiệu năng FP8 tới 4.614 TFLOPs mỗi chip. Khi phần tính toán đã rất mạnh, việc tiếp tục tối ưu đường đi của dữ liệu là bước tiếp theo dễ hiểu. Điều đó cũng lý giải vì sao Google không chỉ chạy theo số TFLOPs, mà còn phải tìm cách giảm chi phí mỗi truy vấn khi TPU bắt đầu phục vụ sản phẩm ở quy mô lớn.

Kiến trúc tách chip có thể đổi cuộc đua ASIC cho AI inference như thế nào

Nếu hướng đi này thành hình, tác động lớn nhất sẽ nằm ở cuộc đua ASIC, tức chip được thiết kế riêng cho một kiểu tác vụ. Khi inference trở thành nơi đốt tiền thật sự, các hãng đám mây sẽ quan tâm nhiều hơn tới chi phí trên mỗi truy vấn thay vì chỉ nhìn benchmark. Điều này cũng nối thẳng với áp lực ở khâu advanced packaging, nơi việc ghép nhiều die và nhiều khối chức năng đang thành nút thắt của chip AI.

| Khối | Vai trò | Lợi ích | Rủi ro |

| TPU chính | Xử lý tensor | Tập trung vào suy luận | Hệ thống phức tạp hơn |

| Chip đi kèm | Gánh bớt dữ liệu và bộ nhớ | Hạ độ trễ inference | Tăng chi phí tích hợp |

| ASIC | Tối ưu cho tác vụ cố định | Rẻ điện hơn GPU ở bài toán rõ ràng | Kém linh hoạt nếu mô hình đổi nhanh |

Nếu Google làm được điều đó, cuộc chơi sẽ dịch từ câu hỏi “chip nào mạnh hơn” sang “hệ thống nào phục vụ inference rẻ hơn”. Đây là nơi ASIC có lợi thế vì có thể cắt bớt phần thừa và bám sát bài toán hơn GPU đa dụng. Nhưng lợi thế đó chỉ giữ được nếu phần mềm, kết nối, đóng gói và chuỗi cung ứng cùng vận hành trơn tru.

Chính vì vậy, những diễn biến như TSMC tăng CapEx trở nên quan trọng hơn. AI inference giờ không còn là chuyện mô hình chạy nhanh đến đâu, mà là ai kiểm soát tốt hơn toàn bộ đường đi của dữ liệu, bộ nhớ và năng lực sản xuất chip. Nếu báo cáo về Google và Marvell là đúng, đây có thể là dấu hiệu cho thấy cuộc đua chip AI đang chuyển từ “làm chip to hơn” sang “chia việc thông minh hơn”.

3 bình luận về “Google kéo Marvell vào TPU hai chip, cuộc đua AI inference đổi chiều ra sao?”